Con Habeas Mentem ci riferiamo al diritto alla tutela della mente umana dalla manipolazione e dallo sfruttamento inconsapevoli, affinché non possano essere utilizzate (per finalità economiche o di altra natura) senza il consenso esplicito dell’individuo. La tutela della mente rispetto al rischio di manipolazione e sfruttamento deve però anche sottrarre l’individuo a possibili forme di ricatto, affinché lo stesso non venga costretto a cedere alcune funzioni o attività mentali per poter accedere a piattaforme cognitive o ambienti relazionali la cui mancata “frequentazione” produrrebbe un malus socialmente o psicologicamente rilevante.

Le declinazioni cognitive del capitalismo globalista hanno messo a valore le piattaforme digitali, relazionali o informazionali, tramite l’intercettazione e rielaborazione dei contenuti al loro interno prodotti (o anche solo affidati) dagli utenti: la centralità degli algoritmi e dei Big Data all’interno delle economie mondiali è ormai sotto gli occhi di tutti.

Ma molte altre questioni sottese all’IA e in generale all’automazione avrebbero dovuto da tempo inserirsi nel dibattito pubblico, anche alla luce del progressivo scollamento tra le crescenti possibilità delle macchine autonome e delle reti neuronali, delle vigenti previsioni giuridiche e delle limitate capacità immaginative del legislatore e dei consumatori o fruitori finali delle nuove tecnologie.

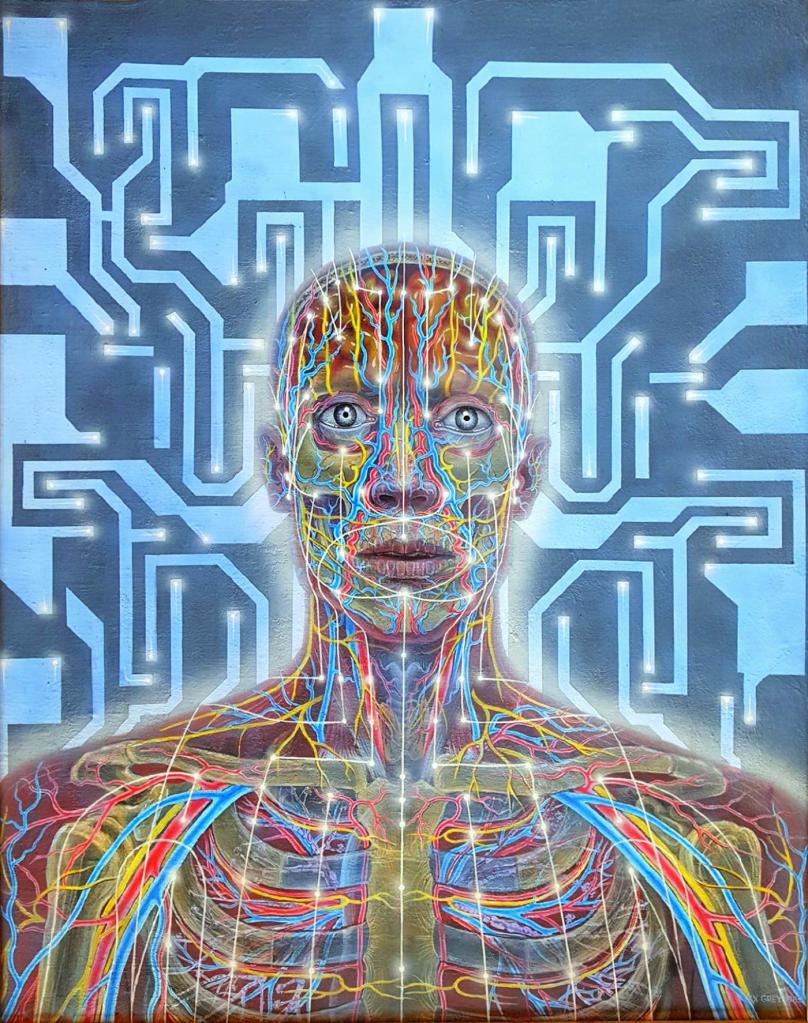

Questioni mai risolte come il sempre attuale divario digitale (in termini di hardware, software e di connettività) vengono così ulteriormente complessificate dall’uso quotidiano di nuovi dispositivi proposti come beni di largo consumo: visori XR di ultima generazione, sensori tattili e varie altre forme di interazione neuronale tra uomo e macchina si apprestano a penetrare tecnologicamente nei meandri della nostra mente, quasi sempre senza renderci preventivamente edotti dei loro funzionamenti. Alcuni utenti inesperti, semplicemente intuendo il “lavoro” prezioso che prestano ogni qual volta si adeguino al modello esperienziale proposto da un dato device o piattaforma, potrebbero legittimamente porsi delle domande, tra cui: come è possibile mantenere la piena consapevolezza di sé in certi contesti? Come essere sicuri di non aver subito alcuna forma di violazione mentale? Conserverei il diritto all’oblìo anche laddove si diffondessero modalità di “scaricamento e conservazione” su supporti digitali delle mie memorie personali?

Da questo punto di vista, la letteratura delle scienze sociali e giuridiche ci riporta indietro di qualche decade a tentativi rudimentali (ma capaci di stimolare una vivace discussione, a suo tempo) di controllo della mente umana, quali la macchina della verità. Ma l’eccessiva approssimazione e inaffidabilità dello strumento non ha favorito lo sviluppo di quel dibattito filosofico di cui avremmo tanto bisogno nell’attuale momento di incertezza giuridica, fisica e biopolitica.

Alcuni fenomeni di radicale trasformazione della nostra vita quotidiana, come la digitalizzazione dell’istruzione o di certi lavori d’ufficio o la robotizzazione di altre mansioni, stanno purtroppo precedendo (a tutta velocità) la formulazione delle ipotesi intorno alle conseguenze profonde, in senso antropologico e non solo, a cui andremo incontro a breve. Nel frattempo, si intravedono all’orizzonte modalità inedite di ripristino di reati di opinione o di forme di censura politica di cui saremo – intenzionalmente o no – tutti complici all’interno di un sistema di relazioni tecnomediate e filtrate da complessi sistemi di profilazione, premiazione ed esclusione (sul modello di quanto già avviene con il credito sociale cinese).

Al rischio di esclusione dalla “realtà esteriore” si aggiunge ora anche il rischio di non poter escludere terzi dall’accesso (ed eventualmente anchedal controllo) alla nostra “realtà interiore”, fino al caso limite di non poter autodeterminare (o di non essere coscienti di non essere in grado di autodeterminare) un processo interpretativo autonomo delle nostre esperienze in contesti, ad esempio, di realtà aumentata o diminuita, o di interazioni come le interrogazioni subite in forma conscia (top-down) e inconscia (bottom-up) mediante l’uso di tecnologie VR o, ancora, di ipotesi (probabilmente ancora per poco) avveniristiche di entanglement quantistico applicato alla mente umana.

Dai primi anni Duemila le neuroscienze sociocognitive, nel contemplare i tre livelli analitici neuronale, cognitivo e sociale e le loro reciproche influenze, hanno progressivamente riportato l’attenzione su alcune questioni giuridiche tradizionali inerenti la difesa della psiche.

Fino a quel momento, il limite esterno (incolumità fisica) e il limite interno (incolumità psichica) sottesi alla nozione di integrità psicofisica sono stati quasi sempre sufficienti a consentire ampie forme di protezione sia all’insegna del diritto alla salute che del rispetto dell’integrità morale del soggetto, specie se la vittima di lesione psichica si trovava in una condizione di precostituita debolezza rispetto all’autore della lesione stessa, grazie alla possibilità di verificare l’esistenza dei concetti richiamati dalle norme penali.

Su tali premesse, è stato possibile vietare condotte lesive della libertà psichica sia ai soggetti collocati in un rapporto paritario rispetto al titolare del bene aggredito sia a quanti potrebbero comprimere tale libertà in funzione dell’esercizio di pubblici poteri. E, a proposito di tutela dell’individuo da entità sovraordinate, merita una riflessione il divieto di tortura come induzione di sofferenza (anche meramente psicologica) allo scopo di intimorire la vittima.

La tortura è mentale non solo quando si ricorre a mezzi (come ad es. sostanze chimiche, si veda il c.d. “siero della verità”) volti a sopprimere la volontà o ottundere i sensi della vittima, ma anche quando si minaccia o esercita violenza verso soggetti affettivamente significativi per la vittima stessa. Molto interessante a tal fine rilevare che, mentre molti studi ed esperimenti dimostrino che la tortura fisica produce genericamente resistenza, con la tortura no touch (un abbinamento di dolore auto-inflitto e deprivazione sensoriale ampiamente sperimentato, per esempio, dalla CIA) la vittima colpita dalla sinergia tra trauma fisico e psicologico capitola più facilmente in quanto si sente, in un certo senso, responsabile delle proprie sofferenze. In verità, si ha tortura anche ogni qual volta lo Stato eserciti la propria autorità con una sproporzione tra fini (ad es. le limitazioni della libertà personale previste dall’ordinamento penale) e mezzi (ad es. un’eccessiva pressione psicologica sconfinante nell’abuso di potere).

Tuttavia, al di là di chi eserciti la tortura mentale, c’è un tendenziale accordo sul fatto che tali pratiche ledano la dignità umana: in quanto tali, non dovrebbero essere considerate disponibili e ancora meno potrebbero essere considerate oggetto di consenso.

La questione della disponibilità delle pratiche potenzialmente lesive della mente umana, però, si complica nel momento in cui viene collocata in ambito sanitario.

Per esempio, quando emerse la possibilità di sottoporsi a pratiche di neurostimolazione come la Deep Brain Stimulation allo scopo di curare il morbo di Parkinson, la valutazione bioetica del rapporto tra benefici (noti) e rischi (non ancora perfettamente noti in termini clinici e di effetti a lungo termine sul tessuto celebrale) si risolse in un tendenziale giudizio di accettabilità della prassi alla luce dei vantaggi terapeutici conseguibili.

Ben diversa fu invece la discussione intorno alle pratiche di neuroenhancement o “neuromiglioramento”, la cui problematicità deriva ancora oggi dal fatto che gli effetti dell’intervento, seppur contestualizzandosi in ambito medico, vanno ben oltre la soglia considerata necessaria per il mantenimento o il ripristino della salute, incidendo sulla condizione mentale (la modifica delle capacità celebrali cognitive, emozionali e motivazionali) mediante tecniche di tipo farmacologico, elettromagnetico, tecnogenetico, chirurgico, ecc..

Per il setting tipicamente medicale di applicazione del neuroenhancement, siamo portati a definire “paziente” il destinatario dell’intervento: eppure non siamo dinanzi a un trattamento terapeutico propriamente detto (il “paziente” è infatti sano) e l’effetto positivo è tale solo nella misura in cui risponde a precise aspettative del paziente stesso (in un parallelismo con la chirurgia estetica, anch’essa – non a caso – non sempre considerata giuridicamente ammissibile).

In alcuni ordinamenti da questa possibilità clinica è pertanto scaturito un conflitto tra il diritto a decidere autonomamente come modificare le proprie facoltà mentali e la presunta contrarietà alla dignità umana di una pratica che nel modificare (specie se irreversibilmente) le caratteristiche cognitive caratterizzanti la specie umana consentirebbe una sorta di scorciatoia evolutiva “contro natura”. Un conflitto di cui comunque il destinatario del “potenziamento” (o comunque l’aspirante tale) è solitamente edotto prima, durante e dopo l’intervento: è in sostanza completamente informato dei pro e contro così come ricostruibili dalle conoscenze scientifiche del momento. Tale apparato conoscitivo è oltretutto a disposizione del Legislatore, per definire limiti e possibilità delle applicazioni mediche (come ad es. i limiti del consenso alle modifiche imprevedibili della personalità), e degli stessi destinatari di interventi, laddove intendessero ottenere la valutazione giuridica di un eventuale danno subito (ad esempio per imperizia di chi li ha operati) e conseguenti risarcimenti.

In merito a quest’ultimo punto, l’incriminazione procede solitamente ricostruendo dettagliatamente il funzionamento dei mezzi (chimici, chirurgici, ecc.) attraverso cui sono state danneggiate le vittime (al netto di eventuali limiti di consenso al neuroenhancement delle stesse). Da questo punto di vista il danno psichico (già ricompreso nel danno biologico) può essere, ad esempio, ulteriormente declinato nel danno o nel trauma “emozionale” alla luce degli ultimi sviluppi delle conoscenze neuro-scientifiche, andando oltre la divisione, ormai superata, tra lo psichico e il biologico.

Oggigiorno questi modelli di analisi e tutela giuridica non sono facilmente trasponibili nell’attuale realtà tecnomediata e a crescente dominazione da parte dell’IA (dominazione che tende a sottrarsi persino al controllo degli stessi esperti, quanto è vero che, ad esempio, le reti neurali non hanno – ancora – valore predittivo, pur essendo composte da algoritmi).

E l’ostacolo sta anche nella diffusa arretratezza giuridica in materia (meno accentuata, ma comunque presente, nei paesi anglosassoni) che diventa, di fatto, un impedimento all’estensione e aggiornamento in chiave tecnologica delle nozioni di capacità di intendere e volere, della responsabilità civile, amministrativa e penale e, non ultimo, delle varie cause di (non) imputabilità.

La manipolazione mentale contemporanea non richiede più la somministrazione o assunzione di sostanze psicotrope, mentre può passare benissimo attraverso un uso inappropriato o distorto di beni e servizi usualmente considerati di interesse generale non economico (televisione, Internet, media multimediali) o da un uso superficiale (o non completamente informato) di strumenti proposti a una vasta platea di fruitori/consumatori sia per finalità conoscitive e operative (ad esempio nel settore educativo e professionale) che meramente ludiche (videogiochi, ecc…).

Una possibile chiave di lettura del problema potrebbe essere rinvenuta, da un lato, nella (ri)definizione della validità e verità del consenso tipico del c.d. diritto del consumatore. Dall’altro, in termini di captazione del consenso così come concepibile dal diritto pubblico e commerciale (problema ad oggi affrontato, prevalentemente, in relazione alle capacità “persuasive” dei nuovi media).

Ma ancora non basta.

Il punto è che è sempre più difficile, sia sul piano bioetico che giuridico, correre ai ripari a posteriori, inseguendo o indagando possibilità tecnologiche (e relative conseguenze psico-sociali) spesso non completamente note nemmeno ai loro produttori e promotori (come peraltro già accaduto in materia di OGM o di inquinamento elettromagnetico). E tale difficoltà non potrà che aumentare, man mano che le nuove attività neurotecnologicamente mediate, sempre più differenziate in termini quali-quantitativi, inizieranno a diffondersi capillarmente presso tutte le fasce di popolazione, con proporzionale aumento della difficoltà a distinguere le varie sfumature applicative.

Una continua e uniforme connessione all’Internet e all’IA (che ci viene sempre prospettata come inevitabile) renderà, oltretutto, ancora più complesso distinguere tra l’uso, poniamo, ludico e professionale di certe funzioni neurologiche tecnomediate. O, ancora, renderà sempre più tortuosa la valutazione di legittimità di un’intrusione (per quanto reversibile e transitoria) nella nostra mente, o di una manipolazione di un nostro processo decisionale.

Non potendo quindi prevedere tutte le possibilità evolutive della tecnologia, e nemmeno volendo abbracciare una cortocircuitante prospettiva luddista, diventa irrinunciabile un’azione preventiva di tipo primario (evitare l’esposizione al problema) o secondario (ridurre il danno a esposizione avvenuta).

É, ad esempio, l’opzione pionieristica che si sta percorrendo in Cile, la cui assemblea costituente ha recentemente posto la discussione intorno ai neurodiritti e alle possibilità di tutela dell’habeas mentem all’ordine del giorno. Si tratta di un inedito giuridico e sociale che vale la pena di monitorare con attenzione: potrebbe risultarne un importante e innovativo precedente di protezione etico-giuridica dei diritti umani fondamentali delle persone (tali sono, infatti, i neurodiritti) per qualunque stato che voglia ancora definirsi democratico.

Gli sforzi in tale direzione verrebbero però comunque vanificati se non si prevedesse, a breve e medio termine, un parallelo adeguamento delle politiche e dei regolamenti nazionali e ancor più transnazionali in materia di privacy e protezione dei dati personali.

Una proposta interessante in tal senso proviene, ad esempio, dalla Neurorights Initiative promossa dal Neurotechnology Center della Columbia University, che delinea (sempre entro una cornice di diritti umani) un interessante set di cinque neurodiritti fondamentali:

- Il diritto all’identità personale (che implica un freno alla neurotecnologia che collega gli individui alle reti digitali, laddove si intraveda il rischio di offuscamento del confine tra coscienza personale e input tecnologici esterni);

- Il diritto al libero arbitrio (e quindi la prevenzione della manipolazione occulta neurotecnologicamente mediata che consentirebbe a forze esterne di controllare il proprio processo decisionale personale);

- Il diritto alla privacy mentale (cioè la conservazione riservata dei Neuro Data provenienti dalla misurazione dell’attività neuronale, con rigorosa regolamentazione della loro vendita, trasferimento commerciale e uso);

- Il diritto all’uguaglianza di accesso al potenziamento mentale (che dovrebbe essere accessibile solo all’interno di linee guida basate sul principio di giustizia e parità di accesso, previa regolamentazione nazionale e internazionale dello sviluppo delle apposite applicazioni neurotecnologiche);

- Il diritto alla protezione da pregiudizi algoritmici (in sostanza, un ricorso all’apprendimento automatico cosciente del rischio di riproporre pregiudizi nel progettare algoritmi nonché delle accortezze necessarie a contrastarli).

Alla luce di quanto fin qui sostenuto, è evidente che dallo stesso (apprezzabile) pentalogo della Columbia University può comunque scaturire un intenso dibattito intorno, per esempio, al punto 4. Si potrebbe infatti obiettare che, in termini di neurodiritti, le pari opportunità saranno veramente tali non tanto – o non solo – quando tutti potranno accedere ai potenziamenti neuronali (sulla cui esclusiva bontà non c’è, almeno per ora, unanime accordo), ma se e finché gli individui non subiranno discriminazioni psicosociali in ragione della loro scelta di accedere o meno a tali potenziamenti. La questione, comunque, è molto complessa e non la affronteremo in questa sede per esigenza di brevità.

Proprio la complessità della materia dovrebbe semmai farci comprendere l’urgenza di misure di informazione e tutela del cittadino, come l’istituzione di comitati bioetici dedicati, capaci di esprimere pareri vincolanti per le istituzioni a livello nazionale e transnazionale e senza coinvolgimento di alcuno dei propri membri in conflitti di interessi di sorta, allo scopo di definire preventivamente, in ambito civile e militare, quei limiti di inviolabilità della mente umana che preservano la dignità della persona.

Il disordine nel mare magnum delle reti neurali e delle nuove tecnologie dell’informazione è infatti prossimo, sul piano dei neurodiritti, a un pericoloso punto di non ritorno: a noi la scelta se assumerci o meno la responsabilità di anticipare e arginare tutte le violazioni dell’Habeas Mentem che consideriamo moralmente inaccettabili al di là del fatto che (anzi: prima che) le evoluzioni tecnologiche le rendano possibili.

Julie Bicocchi

Un pensiero riguardo “Per un’etica dell’Habeas Mentem”